E já tem empresa que anuncia a venda de petição feita por ChatGPT

4 de abril de 2024, 8h00

1. Nem o ChatGPT as pessoas conseguem usar: já estão vendendo o “como fazer”

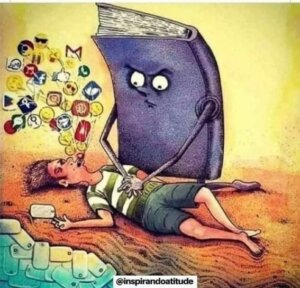

A “pós-modernidade” é incrível. Pois não é que um sujeito anuncia, no Instagram (esse lugar da felicidade e da prosperidade!) [1] um truque: baixe um livro qualquer e o ChatGPT o resume. Por que ler? Leia só o resumo.

E o anunciante se vangloria de não precisar ler? O mundo já acabou?

E como diz a mocinha vestida de azul fazendo publicidade, no mesmo Insta: a empresa tal é a única que lhe remete petições feitas automaticamente. Pelo ChatGPT. Terceirizaram a preguiça. Agora já tem para vender. Ou seja, nem o ChatGPT as pessoas conseguem usar por conta mais. Nem o ChatGPT…! Onde foi que erramos?

A charge abaixo diz tudo!!

2. E você vai virar o rei do conhecimento… basta ler o Código da Persuasão

Outro influencer mostra como você pode ficar “perigoso”. Indica 4 livros. Você vai virar o rei do conhecimento, diz o coach. Céus: o rei do conhecimento! Ele diz isso. Um livro que ele indica é o Código da Persuasão. Em 45 minutos você convence alguém a comprar coisas de você. O Código é “absurdo”, diz. Um MBA neuromarqueting (sic). Tem também o livro Palavras Mágicas. Você o lê e aprende quais palavras convencem as pessoas.

O que houve com a humanidade? Isso é a sério? E o sujeito indica. A sério. Sem ficar ruborizado.

Na área jurídica, vi na “rede da felicidade” um advogado ensinando como usar o ChatGPT. Diz que precisa de um avatar. Fenomenal. O ChatGPT, que é um estelionatário, é municiado para fazer plágio.

E tem outro advogado que se vangloria do fato de que seu escritório (ele parece vender sua expertise nas redes, não entendi bem) usa o ChatGPT para fazer as petições.

3. A SFI: Síndrome da Fadiga de Informações

Talvez estejamos sofrendo de SFI – Síndrome da Fadiga de Informações. Em 1996 David Lewis cunhou o conceito de SFI – Síndrome da Fadiga de Informações. É o que vivemos hoje. Só não sabemos até quando aguentaremos esse “novo” modo de anticomunicação.

A equação é: se tanta gente possui acesso amplo a todo tipo de informação, por qual razão aumenta o número de ignorantes e alienados? A resposta está na SFI. E em T.S. Eliot: informação não é conhecimento; conhecimento não é saber; e saber não é sabedoria. O que temos por aí é tão somente um monte de informações. Nada mais do que isso.

Nosso desafio: evitar a fadiga de informações e, como falei na coluna passada, desabituar desse mundo de ficções, transformando informação em conhecimento. E quiçá, em saber e sabedoria. Com certeza, isso que está aí, esse mundo da esperteza e das trucagens, longe está de ser conhecimento. Mas muito longe.

Resta o conhecimento popular: quem sabe, sabe; quem não sabe, ensina. Inclusive a usar o ChatGPT. Ou vende livros que deixam o leitor “perigoso” – rei do conhecimento!

Mundo, mundo, vasto mundo…

Post scriptum: se não pode vencê-los, junte-se a eles?

Não quero a volta do lápis e nem do ábaco. Porém, preocupa-me o exagero e a corrida ao “novo ouro” – a IA. Poucos dias atrás, ocorreu o 1º Congresso de IA no Direito em uma seccional da Ordem dos Advogados (cf. aqui) e não há dúvida de que o evento chama atenção. Afinal, nada envelhece mais rápido do que a novidade num tempo que a tecnologia nasce pronta para subsistir e ser substituída por algo ainda mais novo.

Seja como for, esse movimento em direção à adoção acelerada de inteligência artificial no setor jurídico merece uma análise um pouco mais cuidadosa. Com a participação de especialistas, eventos como esse costumam adotar um otimismo que pode desconsiderar algumas das profundas implicações éticas, práticas e humanísticas inerentes à algocracia da profissão jurídica.

Considerado que cito esse evento apenas como um mero exemplo para ilustrar o meu ponto, acrescento que o profissional do direito não deve(ria) se tornar um instrumento do seu próprio instrumento. Não afirmo que alguém admita ou pregue isso. Mas se corre esse risco. Basta uma passada d’olhos nas redes sociais…! Mas, o que quero dizer com isso? Quero dizer que depender de prompts [2] e quejandos nada mais é do que adotar um criterialismo ainda mais artificial. Dito de outro modo: corremos o risco de normalizarmos comandos que tendem a instaurar um fator limitador da nossa própria compreensão sobre um determinando caso concreto.

Com efeito, a crescente utilização de prompts na elaboração de petições e outros documentos legais ilustra um autêntico dilema contemporâneo. Essa prática, embora represente um aparente avanço tecnológico, destaca a tensão entre a inovação e a preservação da essência interpretativa da advocacia. O que fazer com a doutrina? Robôs são plagiadores? Chomsky assegura que sim. Eu também. O ChatGPT pega tudo que recebe e devolve sem citar fonte. Não existe o “fator água mineral” para o ChatGPT. Daí a pergunta: a advocacia concorda com isso?

O recurso excessivo a tais ferramentas ameaça reduzir o exercício da advocacia a uma operação mecanizada de processamento de informações, desprovida da reflexão crítica e da compreensão humana que são vitais para o Direito.

Depois nos queixamos dos tribunais, que fulminam nossos recursos com robôs, transformados em snipers anti-hermenêuticos.

Numa palavra, é imperativo reconhecer que a essência da advocacia transcende a mera utilização de instrumentos tecnológicos, por mais avançados que sejam. Aliás, é essa a essência do direito. O advogado, ao se tornar refém das ferramentas que deveriam auxiliá-lo, corre o risco de ser desumanizado pelo próprio mecanismo que visa a servir sua prática.

Alguém dirá: você é um jurássico. Pode ser. Mas continuo pensando que uma boa doutrina é indispensável. Não se faz direito coletando acórdãos e deixando o robô fazer o nosso trabalho. Ou fazer legal design. Ou visual law – o ChatGPT parece ser bom nisso. Porém, nisso reside o paradoxo: se der certo, dará errado. Ou já deu?

Se um robô faz melhor do que o advogado, é porque, paradoxalmente, fracassamos. Se um robô desenha melhor que um designer, houve nisso um fracasso. Se ChatGPT faz melhor que advogado, não tem algo de errado nisso? Se o ChatGPT faz textos plagiados, não há algo de errado aí?

Cartas (sic) para a redação. Que não sejam escritas por robôs.

[2] Nota explicativa: nos termos da própria IA, são instruções iniciais fornecidos a um sistema de Inteligência Artificial, especialmente aos modelos de processamento de linguagem natural, como o ChatGPT. Eles são projetados para desencadear uma resposta específica ou para guiar a IA na geração de conteúdo, análises ou soluções baseadas no texto inserido.

Encontrou um erro? Avise nossa equipe!